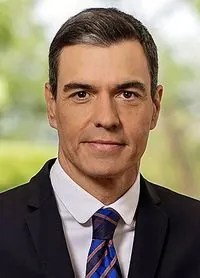

Emily Bender : Une voix critique dans l'évolution de l'IA linguistique

Emily Bender, linguiste américaine, reste sceptique face à l'engouement pour les grands modèles de langage en IA. Elle souligne les risques et questionne leur utilité réelle malgré les améliorations.

Emily M. Bender, linguiste computationnelle américaine et professeure à l'Université de Washington, continue de porter un regard critique sur l'évolution de l'intelligence artificielle (IA) dans le domaine du langage. En tant que directrice du laboratoire de linguistique informatique de son université, elle a acquis une expertise considérable dans ce domaine en pleine expansion.

En mars 2021, Bender a co-écrit un article intitulé "Perroquets stochastiques" avec d'autres chercheurs en éthique de l'IA, notamment Timnit Gebru, Angelina McMillan-Major et Margaret Mitchell. Cet article, devenu une référence dans le secteur, mettait en garde contre les limites et les risques associés aux grands modèles de langage, tels que ceux utilisés dans les robots conversationnels comme ChatGPT.

Les préoccupations soulevées par Bender et ses collègues incluaient les erreurs potentielles, les biais inhérents et l'impact environnemental significatif de ces systèmes massifs. Aujourd'hui, plus de trois ans après la publication de cet article, Bender maintient sa position critique envers l'industrie de l'IA, dénonçant ce qu'elle appelle la "hype" du secteur dans un podcast qu'elle co-anime avec la sociologue Alex Hanna.

Réfléchissant sur l'article de 2021, Bender souligne qu'il s'agissait moins de prédictions que d'avertissements. Elle exprime sa frustration face à la course effrénée vers des modèles de langage toujours plus grands, malgré les défauts potentiels identifiés. Cependant, elle reconnaît que certains aspects n'avaient pas été anticipés, notamment l'exploitation des travailleurs dans l'industrie de l'IA et l'enthousiasme débordant pour le texte synthétique.

Bender remet en question l'idée que l'augmentation de la taille des modèles les rend nécessairement meilleurs. Elle argue que, bien qu'ils excellent dans l'imitation du texte humain, leur utilité réelle reste à démontrer. Elle rappelle que les modèles de langue sont une technologie ancienne, remontant aux travaux de Claude Shannon dans les années 1940, et que leur utilisation initiale dans des domaines tels que la transcription automatique, la correction orthographique et la traduction automatique ne nécessite pas les quantités massives de données d'entraînement actuellement utilisées.

La linguiste souligne également l'importance de la transparence et de la compréhension des systèmes d'IA. Elle affirme qu'en 2020, nous avions déjà dépassé la quantité de données d'entraînement permettant une compréhension claire du fonctionnement interne des modèles, ce qui pose des problèmes pour le développement de technologies fiables.

"Ce n'est pas certain qu'ils soient meilleurs. Ils sont meilleurs pour imiter du texte humain. Mais je ne sais pas à quoi cela sert. Il n'y a pas d'évaluations claires montrant que, pour tel usage, cela nous donne de meilleurs résultats."

En conclusion, Emily M. Bender continue de jouer un rôle crucial dans le débat sur l'éthique et l'utilité des grands modèles de langage en IA. Ses critiques et ses mises en garde invitent à une réflexion approfondie sur la direction que prend le développement de ces technologies et sur leurs implications à long terme pour la société.