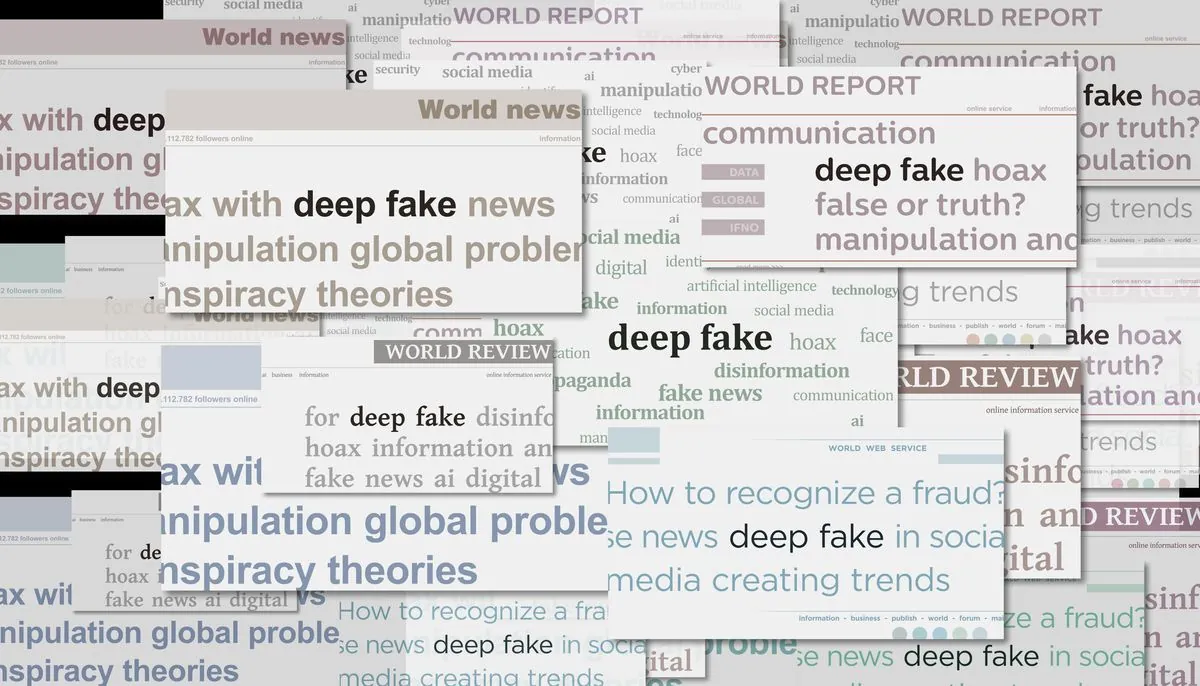

L'IA dans les élections: Comment la tech essaie de contrôler le chaos numérique

Les élections américaines font face à une nouvelle vague de manipulation par lʼIA‚ avec des deepfakes et de la désinformation. Les géants de la tech proposent des solutions‚ mais les défis persistent

Lʼannée électorale américaine montre déjà les dangers de lʼintelligence-artificielle: un deepfake de Donald Trump prétendant avoir le soutien de Taylor Swift et lʼIA Grok de X qui propage des théories douteuses sur Kamala Harris

Les risques principaux sont tri-dimensionnels: lutilisation malveillante‚ le non-alignement avec les valeurs des utilisateurs; et la sur-confiance dans des résultats qui semblent vrais

En février dernier 25 leaders tech-industriels se sont engagés à protéger les élections contre lʼIA (une initiative qui arrive au bon moment). Ils développent des tatouages-numériques: des signatures invisibles dans les images générées conformément aux règles de lʼAI Act européen

Les entreprises comme OpenAI‚ Google et Anthropic cherchent des solutions techniques – chacune avec sa propre approche. OpenAI utilise le retour-humain‚ Google sʼappuie sur ses modèles pré-entrainés; tandis quʼAnthropic développe une IA dite “constitutionnelle“

Malgré ces efforts les chatbots restent vulnérables aux attaques par injection-de-prompt. Les équipes de sécurité (appelées red teams) travaillent sans cesse pour trouver et corriger ces failles